-

Dlaczego OpenAI przyhamowuje z robotami przed giełdowym debiutem

OpenAI zwalnia tempo z gadżetami: o co chodzi z pomysłem wydzielenia robotyki i sprzętu Pod koniec 2025 roku Sam Altman miał na stole plan, który w Dolinie Krzemowej zawsze oznacza jedno: porządki przed giełdą. Według relacji opisywanych przez Ambar Warrick, dyrektor generalny OpenAI rozważał wtedy…

-

Dla introwertyka w Osace: ciche parki, świątynie i kawiarnie z dala od Dotonbori

Jak uciec od Expo i Dotonbori, nie uciekając z Osaki Zdjęcia z Osaki wyglądają zwykle tak samo: neony Dotonbori, tłum pod wielkim krabem, ekrany krzyczące z każdej strony. W rzeczywistości po godzinie przeciskania się tą ulicą człowiek zaczyna marzyć tylko o jednym – żeby po…

-

Kulinarna Osaka poza Dotonbori: gdzie naprawdę jeść okonomiyaki, takoyaki i kushikatsu

Dlaczego warto uciec z Dotonbori na jedzenie w Osace Mój pierwszy wieczór w Osace wyglądał jak z katalogu. Neony nad Dotonbori, tłum jak na koncercie, wszyscy robiący te same zdjęcia z krabem i Glico Manem. Wpakowałem się w pierwszą lepszą kolejkę do stoiska z takoyaki,…

-

Universal Studios Japan 2025: dzień w USJ, nowe Donkey Kong Country i przetrwanie tłumów Expo

Co nowego w Universal Studios Japan: Super Nintendo World rośnie, Donkey Kong wjeżdża na planszę Universal Studios Japan siedzi sobie na zachodniej krawędzi Osaki, nad zatoką. Z centrum dojechałem tam zwykłym pociągiem w niecałe pół godziny: zero romantyzmu, ale działa. Stacja nazywa się po prostu…

-

Którą wyspę Okinawy wybrać? Naha, Kerama, Miyako czy Ishigaki – praktyczne porównanie

Okinawa w pigułce: jak w ogóle ogarnąć te wyspy Kiedy pierwszy raz usiadłem do planowania Okinawy, byłem przekonany, że to jedna wyspa z jedną plażą „jak z katalogu” i wszystkimi palmami w jednym rzędzie. Pięć minut później okazało się, że mam przed sobą całą gromadkę:…

-

Sezon na Okinawie: kiedy jechać na plaże, nurkowanie i workation?

Okinawa przez cały rok? Krótkie rozpoznanie terenu Okinawa to taki japoński plot twist. Lecisz do Japonii, myślisz o świątyniach w Kioto i zimnym wietrze w Tokio, a nagle lądujesz w tropikach, gdzie w lutym widzisz ludzi w klapkach. Inny klimat, inne pory deszczowe, inne „szczyty…

-

Okinawa budżetowo: realny koszt tygodnia (i dłużej) w japońskich tropikach

Czy Okinawa to wciąż egzotyka na bogato? Krótkie spojrzenie na aktualne ceny Okinawa brzmi jak wakacyjne bingo: turkusowa woda, palmy, Japonia, ryż z ananasem i delfiny w folderach. Z polskiej perspektywy od razu dochodzi jeszcze jedno słowo: „drogo”. I to takie drogo, że człowiek odruchowo…

-

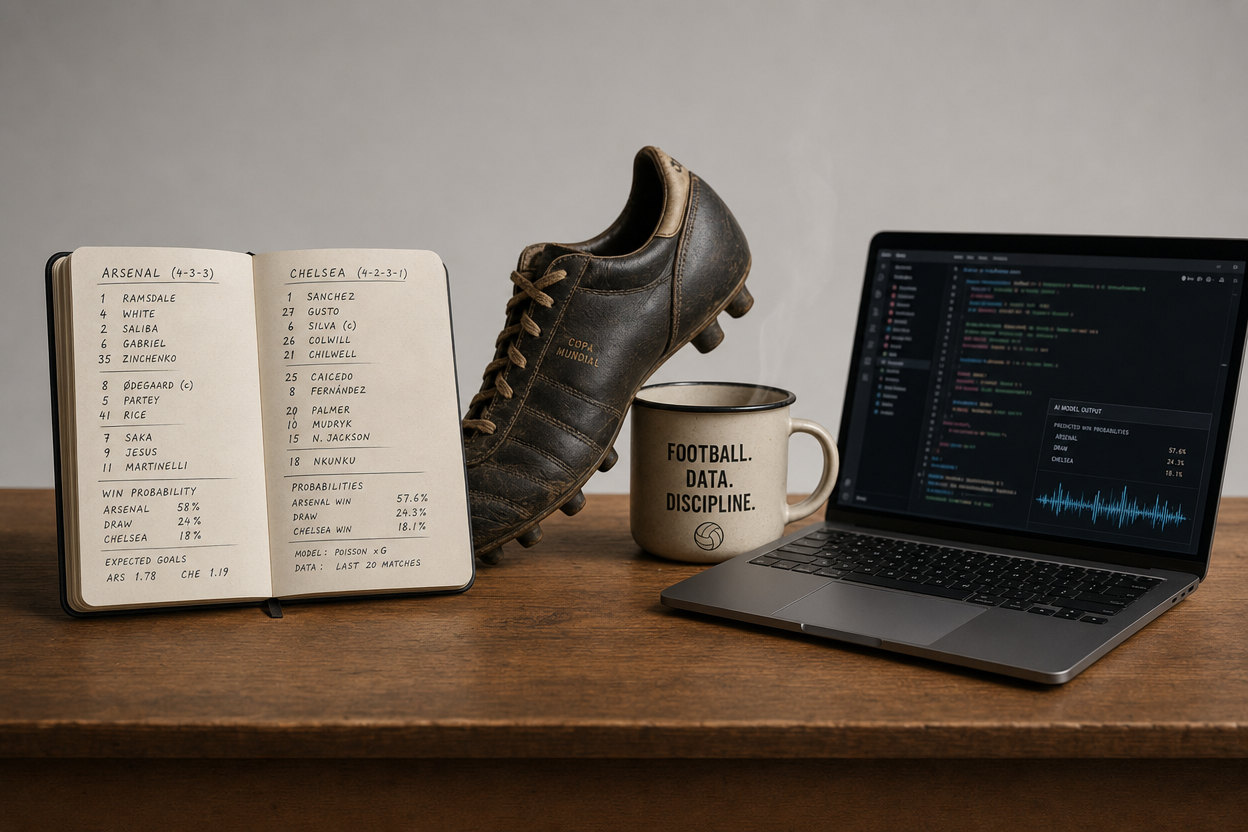

Prognozy sportowe z AI: co ChatGPT „wie” o A‑Klasie i B‑Klasie (i czego lepiej mu nie zlecać)

Weekendowe typowanie z AI: o co chodzi z prognozami meczów A‑Klasy i B‑Klasy Piątek wieczór, praca odhaczona, kanapka gotowa, telefon w dłoń. Zamiast przeklikiwać się przez tabele i fora, kibic niższych lig otwiera okienko z ChatGPT i pyta wprost: „No dobra, jakie wyniki padną w…

-

OpenAI vs Anthropic: nowa wojna o zarządy i budżety na AI w 2026 roku

Dlaczego giganci AI nagle kochają spotkania z zarządami Jeszcze rok temu wielu prezesów myślało o AI w kategoriach: „mamy gdzieś tego chatbota na stronie, prawda?”. Dziś w sali zarządu siada zespół z OpenAI albo Anthropic, na stole ląduje prezentacja na 60 slajdów, a w pierwszym…