Indie jako nowy front w globalnym wyścigu AI

AI Impact Summit w New Delhi został zapowiedziany jako przełomowy moment dla Globalnego Południa. Organizatorzy przedstawiali go jako pierwsze duże forum sztucznej inteligencji tej części świata, miejsce, w którym kraje rozwijające się mają zabrać głos w debacie zdominowanej dotąd przez Waszyngton, Brukselę i Pekin. W zamyśle szczyt miał wzmocnić ambicje Indii jako jednego z głównych ośrodków globalnego ładu AI.

Ten cel wpisuje się w szerszy kontekst rozwoju Indii. Kraj ten od dwóch dekad jest jednym z kluczowych zapleczy dla globalnego sektora IT, dostarczając programistów, inżynierów danych i menedżerów projektów do Doliny Krzemowej oraz największych koncernów technologicznych. Bangalore i Hyderabad stały się rozpoznawalnymi markami na mapie światowej innowacji, a indyjscy specjaliści obejmują kluczowe stanowiska w amerykańskich firmach technologicznych – z Sundarem Pichaiem na czele Google jako najbardziej spektakularnym przykładem.

Rząd Narendry Modiego próbuje tę przewagę kapitału ludzkiego przełożyć na większy wpływ polityczny. Premier od lat buduje narrację Indii jako rzecznika Globalnego Południa w sprawach technologicznych i cyfrowych, argumentując, że standardy rozwoju AI nie mogą być dyktowane wyłącznie przez państwa bogate. AI Impact Summit miał być pokazem tej roli: na jednej scenie spotkali się Narendra Modi, prezydent Francji Emmanuel Macron, szef Google Sundar Pichai, dyrektor generalny OpenAI Sam Altman oraz CEO Anthropic Dario Amodei.

Symbolika ich wspólnej obecności była czytelna. Sygnał miał być podwójny: po pierwsze, Indie jako gospodarz potrafią zgromadzić przy jednym stole liderów politycznych i biznesowych pierwszej ligi; po drugie, Globalne Południe staje się miejscem, gdzie ustala się zasady globalnej gry w obszarze AI, a nie tylko polem testowym dla cudzych technologii.

Oczekiwania wobec szczytu były bardzo wysokie. Rząd w New Delhi zapowiadał wielomiliardowe inwestycje w infrastrukturę danych, centra obliczeniowe i projekty oparte na sztucznej inteligencji. W przestrzeni publicznej pojawiały się zapowiedzi zarysowania bardziej inkluzywnego, „nie‑zachodniego” porządku regulacji AI – takiego, który uwzględnia potrzeby krajów rozwijających się, a jednocześnie nie dławi innowacyjności nadmierną biurokracją. Szczyt miał także wzmocnić pozycję Indii wobec USA, Chin i Unii Europejskiej jako równorzędnego partnera w dyskusji o standardach bezpieczeństwa i odpowiedzialności sztucznej inteligencji.

Rzeczywistość okazała się jednak znacznie bardziej skomplikowana. Choć na scenie pojawili się najważniejsi aktorzy światowego ekosystemu AI, a skala deklarowanych inwestycji robiła wrażenie, wydarzeniu nie udało się przełamać symbolicznej bariery: zbudować trwałego wrażenia, że powstało nowe, wiarygodne centrum koordynacji globalnej polityki AI.

Od wielkich obietnic do organizacyjnego chaosu

Już pierwsze godziny szczytu pokazały wyraźny rozdźwięk między starannie wyreżyserowanym obrazem na scenie a doświadczeniem uczestników i mieszkańców New Delhi. Zaproszeni goście relacjonowali zamknięte hale wystawowe, utrudniony dostęp do części wydarzeń i dezorientację wynikającą z niejasnej komunikacji organizatorów.

Policja wielokrotnie blokowała główne arterie dwudziestomilionowego miasta, aby zapewnić przejazd kolumn VIP-ów. Dla mieszkańców oznaczało to korki, opóźnienia i poczucie, że kolejny „globalny spektakl” odbywa się ich kosztem. Dla wielu uczestników spoza ścisłego kręgu najważniejszych gości problemy z logistyką były na tyle poważne, że utrudniały udział w panelach czy spotkaniach networkingowych – faktycznej treści takiego forum.

Relacje agencji informacyjnych, w tym reuters.com, podkreślały, że komunikacyjny chaos i seria wpadek organizacyjnych przyćmiły nawet imponujące deklaracje inwestycyjne. W praktyce to nie wysokość ogłoszonych kwot, lecz obrazy zamkniętych hal i zdezorientowanych uczestników zdominowały przekaz medialny po zakończeniu wydarzenia.

Kontrast między obrazem „technologicznego spektaklu” na głównej scenie a rzeczywistością logistyczną jest czymś więcej niż anegdotą. To ilustracja szerszego problemu, z którym mierzy się wiele rządów i organizatorów wielkich forów technologicznych. Szczyty tego typu są coraz częściej traktowane jako narzędzie wizerunkowe: okazja do spektakularnych zdjęć, przemówień i deklaracji, które mają podkreślić ambicje państwa czy miasta. Tymczasem ich realna wartość zależy od transparentności procesu, jakości merytorycznej dyskusji i zdolności do budowania trwałych mechanizmów współpracy.

W przypadku New Delhi poczucie chaosu podważyło wizerunek Indii jako państwa gotowego przewodzić delikatnej, złożonej debacie o globalnym ładzie AI. Dla inwestorów i partnerów instytucjonalnych jest to ważny sygnał: jeśli kraj aspiruje do roli centrum koordynacji tak złożonego obszaru, musi wykazać się nie tylko wizją polityczną, lecz także bardzo wysokimi kompetencjami organizacyjnymi i kulturą zarządzania.

„Chiński” robot jako symbol geopolitycznej wpadki

Na tle problemów logistycznych szczególnie mocno wybrzmiał epizod z robotem prezentowanym na jednym ze stoisk. Indyjski uniwersytet Galgotias zaprezentował humanoidalnego robota jako własne osiągnięcie technologiczne. W krótkim czasie okazało się jednak, że jest to komercyjnie dostępny produkt chińskiej firmy, dostępny na rynku pod inną marką.

Po ujawnieniu tego faktu w mediach społecznościowych i wśród uczestników wybuchło oburzenie. Zarzuty dotyczyły nie tylko braku rzetelności, ale wręcz wprowadzania w błąd opinii publicznej co do poziomu zaawansowania indyjskich badań. Organizatorzy poprosili uniwersytet o usunięcie stoiska, próbując zminimalizować szkody wizerunkowe.

Ten incydent ma jednak znaczenie szersze niż jedna kompromitacja. W wielu krajach Globalnego Południa presja, aby „pokazać się” w obszarze AI, jest ogromna. Rządy i instytucje akademickie odczuwają potrzebę demonstracji, że „również nadążają” za globalnym wyścigiem technologicznym. Efektem bywa pompowanie projektów o charakterze PR-owym, których realna wartość badawcza lub innowacyjna jest ograniczona. Dla krótkoterminowego efektu medialnego ryzykuje się długoterminową utratę wiarygodności.

W Indiach sprawa jest szczególnie wrażliwa ze względu na napięte relacje polityczne z Chinami oraz jednoczesną, faktyczną zależność od chińskiej elektroniki i sprzętu. Znaczna część komponentów niezbędnych do budowy nowoczesnych systemów AI – od serwerów po wyspecjalizowane moduły – pochodzi z azjatyckich łańcuchów dostaw, w których firmy chińskie odgrywają kluczową rolę. W takim kontekście zarzut, że „indyjskie innowacje” są w praktyce rebrandowanymi produktami z Chin, uderza szczególnie mocno.

Przypadek „chińskiego” robota można odczytywać jako ostrzeżenie dla wszystkich państw aspirujących do roli liderów AI. Bez przejrzystości, własnego zaplecza badawczo‑rozwojowego i uczciwej komunikacji trudno budować trwałą wiarygodność. Deklaracje o „suwerenności technologicznej” muszą być poparte inwestycjami w ludzi, infrastrukturę i własne projekty, a nie jedynie pokazami na targowych stoiskach.

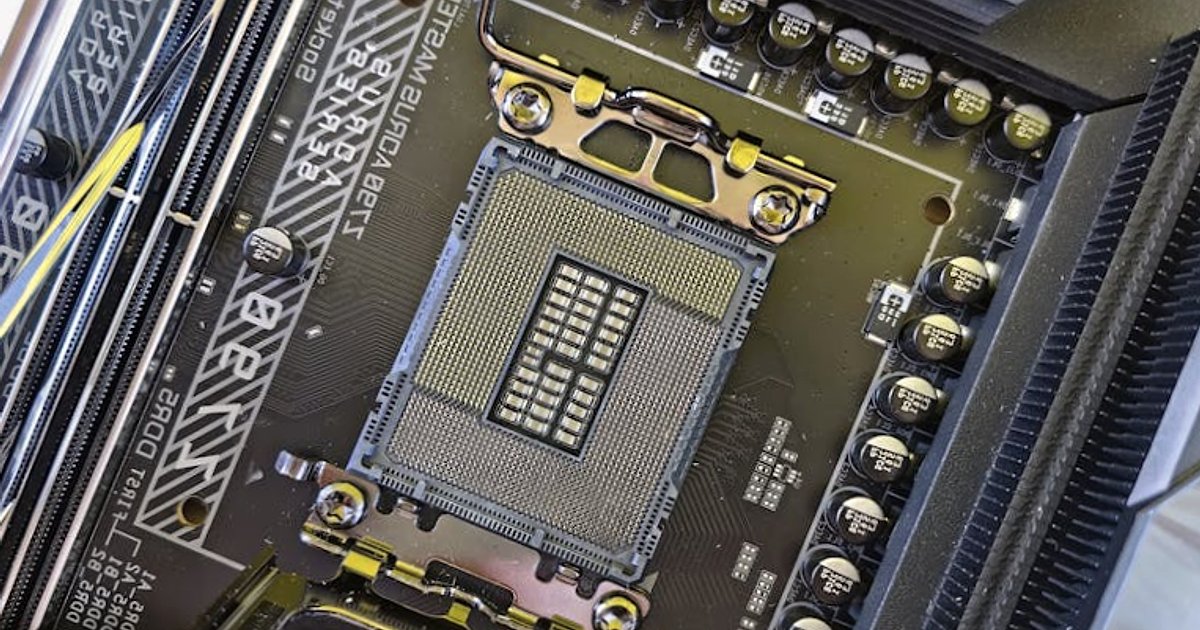

W tle znajduje się też twardy wymiar infrastrukturalny wyścigu AI: moc obliczeniowa. Wysokowydajne karty graficzne, rozproszone klastry GPU i nowoczesne centra danych stają się nową walutą geopolityczną. O tym, jak bardzo rosną wymagania sprzętowe związane z trenowaniem i wdrażaniem modeli, pisaliśmy szerzej w analizie GeForce RTX 5090 Performance: AI Supercomputing Meets 4K Gaming, pokazując, że nawet sprzęt konsumenowy z najwyższej półki zaczyna ocierać się o parametry typowe dla małych superkomputerów. Dla państw, które chcą mieć realny udział w rozwoju AI, oznacza to konieczność przemyślanej, długofalowej strategii inwestycji w infrastrukturę.

Scena pełna gwiazd i niewygodne gesty: co naprawdę pokazały obrazy ze szczytu

Najbardziej rozpoznawalnym obrazem AI Impact Summit stało się wspólne zdjęcie premiera Modiego, prezydenta Macrona i liderów branży AI: Sundara Pichaia, Sama Altmana oraz Dario Amodeia. Z uniesionymi rękami, uśmiechem i deklaracjami troski o „odpowiedzialną AI” mieli wysłać światu sygnał jedności i determinacji.

To właśnie podczas tej sesji doszło jednak do symbolicznie wymownej sceny. Gdy uczestnicy ustawili się, by chwycić się za ręce, Sam Altman i Dario Amodei – stojący obok siebie jako reprezentanci konkurujących firm OpenAI i Anthropic – wyraźnie unikali tego gestu. Ujęcia, na których dwaj kluczowi rywale w wyścigu po zaawansowaną AI stoją obok siebie z opuszczonymi rękami, szybko obiegły media społecznościowe i stały się jednym z najczęściej komentowanych momentów szczytu.

W warstwie symbolicznej to obraz bardzo trafnie podsumowujący obecny stan globalnego ładu AI. Na poziomie deklaracji panuje pozorna jedność: wszyscy mówią o bezpieczeństwie, odpowiedzialności, ochronie dzieci w przestrzeni cyfrowej, inkluzywnym rozwoju. Na poziomie faktycznych interesów mamy jednak do czynienia z ostrą konkurencją między firmami i państwami, które walczą o pozycję, rynek i kontrolę nad standardami technicznymi.

Oficjalne wystąpienia podczas szczytu koncentrowały się na kilku dominujących tematach. Narendra Modi w inauguracyjnym przemówieniu apelował o większą ochronę dzieci i rodzin w świecie zdominowanym przez narzędzia AI, podkreślając potrzebę projektowania technologii z myślą o najsłabszych użytkownikach. Liderzy firm technologicznych akcentowali z kolei kwestie bezpieczeństwa modeli, walki z dezinformacją oraz inkluzywnego dostępu do korzyści płynących z AI.

To jednak tam, gdzie kończyła się wspólna narracja, zaczynały się różnice interesów. Dla korporacji kluczowe jest utrzymanie możliwości szybkiej komercjalizacji nowych rozwiązań przy relatywnie elastycznym otoczeniu regulacyjnym. Dla rządów – zwłaszcza w Europie – istotne jest przede wszystkim ograniczanie ryzyk społecznych i politycznych związanych z niekontrolowanym wdrażaniem zaawansowanych systemów. Kraje Globalnego Południa z kolei obawiają się zarówno bycia zapóźnionymi technologicznie, jak i bycia sprowadzonymi do roli poligonów doświadczalnych dla cudzych algorytmów.

W tle toczy się coraz ostrzejszy spór o to, jakie standardy regulacyjne mają obowiązywać na świecie. Unia Europejska przyjęła podejście zinstytucjonalizowane, którego symbolem jest AI Act – rozbudowany, ramowy akt prawny wprowadzający klasy ryzyka i precyzyjne wymogi dla dostawców systemów. Stany Zjednoczone stawiają na bardziej miękkie instrumenty: wytyczne wykonawcze, samoregulację branży i dobrowolne zobowiązania. Chiny rozwijają własny, silnie scentralizowany model kontroli nad AI, powiązany z szerszym systemem nadzoru cyfrowego.

Indie i inne państwa Globalnego Południa próbują odnaleźć się między tymi biegunami. AI Impact Summit miał być dowodem, że istnieje przestrzeń dla alternatywnej wizji, w której kraje rozwijające się współtworzą zasady, a nie jedynie dostosowują się do cudzych. To napięcie między deklarowaną jednością a faktyczną konkurencją przygotowuje grunt pod szerszą analizę geopolitycznego wymiaru globalnego ładu AI.

Polityczne napięcia wokół globalnego ładu AI

Globalny ład AI można rozumieć jako zestaw zasad, norm i instytucji, które kształtują sposób projektowania, trenowania, wdrażania i nadzorowania systemów sztucznej inteligencji. Obejmuje on zarówno twarde regulacje prawne, jak i miękkie standardy branżowe, mechanizmy nadzoru, fora dialogu międzynarodowego oraz praktyki w organizacjach publicznych i prywatnych.

AI Impact Summit wpisuje się w coraz gęstszą mapę inicjatyw w tym obszarze. W ramach G7 powołano tzw. Hiroshima AI Process, którego celem jest wypracowanie wspólnego podejścia do ryzyk związanych z najbardziej zaawansowanymi modelami. Na forum ONZ trwają prace nad globalnymi wytycznymi dotyczącymi etycznego wykorzystania AI oraz potencjalnymi mechanizmami koordynacji. Unia Europejska kończy proces legislacyjny AI Act, tworząc jedno z najbardziej kompleksowych ram regulacyjnych na świecie. USA, Chiny, Wielka Brytania i inne państwa rozwijają własne strategie narodowe.

W tym pejzażu Indie starają się pozycjonować jako „głos globalnej większości” – krajów, które obawiają się, że jeśli nie zabiorą aktywnie głosu, zostaną jedynie odbiorcami standardów pisanych w Brukseli, Waszyngtonie czy Pekinie. Dla wielu z nich kluczowe jest, aby regulacje nie blokowały dostępu do technologii ani nie przerzucały na nie nadmiernych kosztów dostosowania, na które bogatsze państwa mogą sobie pozwolić.

Napięcia są widoczne na kilku poziomach. Po pierwsze, między USA a UE istnieje realna różnica filozofii: Stany obawiają się spowolnienia innowacji przez zbyt sztywne regulacje, Europejczycy z kolei podkreślają priorytet ochrony praw obywatelskich, nawet kosztem tempa rozwoju branży. Po drugie, rywalizacja z Chinami dodaje do debaty wymiar bezpieczeństwa narodowego i kontroli nad łańcuchami dostaw krytycznych technologii. Po trzecie, mniejsze państwa – zarówno w Europie, jak i w Globalnym Południu – sygnalizują obawy, że staną się jedynie rynkami zbytu i terenami testowymi dla narzędzi zaprojektowanych gdzie indziej.

Szczyt w Indiach miał pokazać, że można budować bardziej inkluzywny porządek, w którym interesy tych krajów zostaną należycie uwzględnione. Chaotyczna oprawa wydarzenia i symboliczne wpadki osłabiły jednak ten przekaz. Zamiast obrazu dojrzalego centrum koordynacji, świat zobaczył forum, które wciąż bardziej polega na efektownych deklaracjach niż na konkretnych, instytucjonalnych mechanizmach nadzoru czy współpracy.

Podobne napięcia pomiędzy tempem innowacji a potrzebą utrzymania wysokich standardów bezpieczeństwa i jakości obserwujemy również w świecie nauki. W naszym tekście AI w nauce: rekord publikacji, rosnące ryzyka i nowe standardy jakości badań pokazujemy, jak gwałtowny wzrost liczby prac wykorzystujących AI zmusza instytucje badawcze do redefinicji kryteriów rzetelności, przejrzystości i replikowalności wyników. W obszarze polityki publicznej stawka jest podobna – chodzi o to, aby szybki rozwój technologii nie odbywał się kosztem zaufania społecznego.

W tym kontekście AI Impact Summit można uznać raczej za symptom trudności w budowaniu nowego ładu niż za krok milowy w jego tworzeniu. Pokazał, że ambicje polityczne muszą iść w parze z dojrzałością instytucjonalną i zdolnością do przekuwania wizji w konkretne, wiążące ustalenia.

Wycofanie się Billa Gatesa: sygnał ostrzegawczy czy taktyczny manewr?

Dodatkowym ciosem dla wizerunku szczytu była rezygnacja Billa Gatesa z udziału na kilka godzin przed planowanym wystąpieniem inauguracyjnym. Założyciel Microsoftu i filantrop miał otwierać wydarzenie, co samo w sobie stanowiłoby mocny sygnał dla inwestorów i opinii publicznej. Ostatecznie jednak do tego nie doszło.

Fundacja Gatesa w krótkim komunikacie poinformowała, że miliarder nie zabierze głosu, aby – jak stwierdzono – „skupić uwagę na kluczowych priorytetach szczytu AI”. Jeszcze kilka dni wcześniej przedstawiciele jego otoczenia zaprzeczali doniesieniom o planowanej nieobecności, co podkreślały m.in. relacje reuters.com. W efekcie decyzja ogłoszona tuż przed inauguracją została odebrana jako niespodziewany, negatywny sygnał.

Motywacje takiego kroku pozostają w sferze spekulacji. Można wyobrazić sobie co najmniej trzy scenariusze. Po pierwsze, obawa przed firmowaniem własnym nazwiskiem wydarzenia, które już przed rozpoczęciem było krytykowane za chaos organizacyjny i kontrowersje wokół „chińskiego” robota. Po drugie, chęć uniknięcia wciągnięcia w wewnętrzne spory pomiędzy wielkimi graczami branży AI, których interesy polityczne i biznesowe coraz częściej się ścierają. Po trzecie, możliwe, że ostatecznym powodem były prozaiczne kwestie agendy i priorytetów innych działań fundacji.

Niezależnie od rzeczywistych przyczyn, rezygnacja Gatesa miała istotny wymiar symboliczny. Dla inwestorów i regulatorów to sygnał, że nawet przy tak starannie dobranej liście gości zaufanie do formuły tego konkretnego wydarzenia nie było pełne. Może to wzmacniać wrażenie, że najważniejsi aktorzy globalnej sceny AI wolą dziś stawiać na bardziej przewidywalne, instytucjonalnie osadzone fora – takie jak ONZ, G7 czy wyspecjalizowane instytucje nadzorcze – niż na ad hoc organizowane szczyty, których przebieg jest trudniejszy do kontrolowania.

Dla Indii to bolesny sygnał: wizerunek kraju jako stabilnego, przewidywalnego partnera w obszarze zaawansowanych technologii został wystawiony na próbę. W krótkim okresie nie musi to oznaczać odwrotu inwestorów, ale z pewnością zwiększa presję, aby kolejne tego typu inicjatywy były lepiej przygotowane i pozbawione podobnych wpadek.

Co zostanie po szczycie w Indiach: realne inwestycje, ryzyka i lekcje na przyszłość

Pomimo wszystkich kontrowersji AI Impact Summit przyniósł konkretne deklaracje finansowe. Według indyjskich władz podczas wydarzenia ogłoszono zobowiązania inwestycyjne przekraczające 100 mld dol., głównie w projekty związane z infrastrukturą AI, budową centrów danych, rozwojem chmury obliczeniowej i wsparciem lokalnych ekosystemów start‑upowych. Wśród głównych graczy znalazły się m.in. Microsoft oraz konglomerat Adani Group. Rząd zapowiada, że w ciągu dwóch lat łączna wartość zobowiązań może przekroczyć 200 mld dol.

W praktyce takie deklaracje oznaczają kilka równoległych procesów. Po pierwsze, intensywną rozbudowę infrastruktury: centrów danych, światłowodów, lokalnych hubów obliczeniowych. Po drugie, programy szkoleniowe dla setek tysięcy specjalistów – od inżynierów oprogramowania po analityków danych i menedżerów projektów AI. Po trzecie, rozwój lokalnych ekosystemów innowacji, w których globalne korporacje współpracują ze start‑upami, uczelniami i instytucjami publicznymi.

Jednocześnie pojawia się ryzyko koncentracji korzyści w rękach wąskiej grupy korporacji. Gdy największe firmy technologiczne budują i kontrolują kluczowe elementy infrastruktury, państwa goszczące muszą szczególnie dbać o równowagę interesów – tak, aby lokalne przedsiębiorstwa i instytucje nie stały się jedynie klientami w zewnętrznych ekosystemach, pozbawionymi rzeczywistego wpływu na kierunek rozwoju technologii.

Pytanie, na ile chaos organizacyjny i wizerunkowe wpadki AI Impact Summit utrudnią realizację tych planów, pozostaje otwarte. Wielu inwestorów odróżnia „szum medialny” wokół jednorazowego wydarzenia od oceny twardych fundamentów gospodarki: stabilności makroekonomicznej, jakości prawa, kompetencji administracji, dostępności talentów. Z tej perspektywy Indie nadal pozostają jednym z najbardziej atrakcyjnych rynków dla projektów AI. Jednak w świecie, w którym reputacja i zaufanie odgrywają rosnącą rolę, takie epizody nie pozostają całkowicie bez wpływu.

Z perspektywy organizatorów przyszłych globalnych szczytów AI z indyjskiego doświadczenia płynie kilka kluczowych lekcji. Po pierwsze, fundamentalne znaczenie ma wiarygodność i przejrzystość. Przypadek „chińskiego” robota pokazał, że każde podejrzenie manipulacji lub przesady w prezentowaniu osiągnięć technologicznych może w kilka godzin zniszczyć starannie budowaną narrację sukcesu.

Po drugie, konieczna jest spójność między ambicjami politycznymi a kompetencjami organizacyjnymi. Jeśli kraj aspiruje do roli jednego z centrów globalnego ładu AI, musi udowodnić, że potrafi bezbłędnie zorganizować wydarzenie tej skali – od logistyki po komunikację z uczestnikami i mieszkańcami gospodarza.

Po trzecie, prawdziwa inkluzywność wymaga czegoś więcej niż zdjęć na scenie. Budowa globalnego ładu AI wymaga realnego włączania szerokiego spektrum aktorów – badaczy, biznesu, społeczeństwa obywatelskiego, przedstawicieli mniejszych państw – do współtworzenia zasad, a nie tylko do potwierdzania przygotowanych z góry deklaracji.

Wreszcie, warto dostrzec różnicę między spektakularnymi wydarzeniami konferencyjnymi a cichą, codzienną zmianą, która dokonuje się na styku konkretnych produktów i zachowań użytkowników. To właśnie tam rodzą się praktyczne standardy korzystania z AI. Dobrym przykładem jest rozwój narzędzi doradczych w e‑commerce. W analizie ChatGPT jako osobisty doradca zakupowy: szansa dla e‑commerce czy ryzyko dla konsumenta? pokazujemy, jak wykorzystanie modeli językowych do rekomendowania produktów stawia nowe pytania o przejrzystość, odpowiedzialność i ochronę konsumentów. To właśnie takie zastosowania – testowane codziennie przez miliony użytkowników – w praktyce definiują, czym staje się sztuczna inteligencja w gospodarce i społeczeństwie.

Szczyt AI w Indiach miał być mocnym sygnałem, że Globalne Południe jest gotowe nie tylko korzystać z AI, ale także współtworzyć zasady jej rozwoju. Zamiast przełomu otrzymaliśmy mieszankę ambitnych deklaracji, organizacyjnego chaosu i symbolicznych wpadek. Nie przekreśla to długoterminowego potencjału Indii w obszarze AI, ale stanowi wyraźne ostrzeżenie: w epoce, w której sztuczna inteligencja staje się infrastrukturą krytyczną, dojrzałość instytucjonalna i wiarygodność są równie ważne jak liczba podpisanych umów inwestycyjnych.

2 responses to “Szczyt AI w Indiach: chaos organizacyjny, polityka i nieobecny Bill Gates”

Bardzo ciekawie opisujesz ten zderzający się ze sobą potencjał i chaos – z jednej strony Indie jako technologiczny gigant, z drugiej organizacyjny i polityczny bałagan wokół szczytu. Zastanawiam się, czy ten brak spójności i obecność lokalnych gier politycznych nie spowoduje, że Globalne Południe straci kolejną szansę na realny wpływ na kształt regulacji AI. Jak Twoim zdaniem Indie mogłyby praktycznie przełożyć swoje aspiracje przywódcze w AI na konkretne instytucje, standardy czy koalicje, które faktycznie coś zmienią w globalnej debacie?

Patrycja, dziękuję – świetnie wychwyciłaś ten rozdźwięk między ambicją a chaosem. Jednym bardzo konkretnym krokiem, który wykracza trochę poza to, co pisałem, byłoby stworzenie przez Indie stałego, międzyrządowego „AI standards hub” z udziałem innych krajów Globalnego Południa, który przygotowywałby wspólne propozycje technicznych norm (np. oceny ryzyka modeli, przejrzystości danych) i jako blok wnosił je równocześnie do ISO, IEEE oraz negocjacji w ONZ – wtedy lokalne gry polityczne trudniej byłoby przerzucić na poziom globalny, bo istniałby sformalizowany mandat i wspólna dokumentacja techniczna wychodząca nie tylko z Delhi, ale z całej koalicji.