-

Dlaczego Anthropic powiedziało „nie” Pentagonowi? Etyczne granice sztucznej inteligencji w erze wojny i inwigilacji

Claude na celowniku Pentagonu: dlaczego jedna firma AI stała się symbolem oporu Gdy na Bliskim Wschodzie narastają napięcia, a scenariusze konfliktu z udziałem Iranu wracają do analiz sztabów wojskowych, w Waszyngtonie toczy się równolegle mniej widoczna, lecz równie znacząca batalia – o to, jak daleko państwo może się posunąć w wykorzystywaniu sztucznej inteligencji. W centrum…

-

Atak prompt injection na OpenClaw: czego uczy nas pierwszy kryzys bezpieczeństwa agentów AI

Dlaczego incydent bezpieczeństwa w OpenClaw to sygnał ostrzegawczy dla całej branży AI OpenClaw stał się jednym z najbardziej znanych narzędzi typu „osobisty asystent AI” – otwarto‑źródłowym frameworkiem, który pozwala modelowi językowemu sterować komputerem, czytać i modyfikować pliki, korzystać z terminala oraz łączyć się z zewnętrznymi usługami. Dla użytkownika oznacza to ogromną wygodę: agent może samodzielnie…

-

Czy AI naprawdę nas ogłupia? Jak korzystać z ChatGPT i Claude, żeby wzmacniać, a nie osłabiać mózg

Nowe ostrzeżenia z Harvardu: co naprawdę budzi niepokój w rozwoju sztucznej inteligencji W ciągu zaledwie kilkunastu miesięcy narzędzia generatywnej sztucznej inteligencji – takie jak ChatGPT, Claude czy Gemini – przeszły drogę od technologicznej ciekawostki do stałego elementu codziennej pracy milionów ludzi na całym świecie. Konsultanci używają ich do przygotowywania prezentacji, prawnicy do szkicowania umów, marketerzy…

-

Anthropic odrzuca 200 mln dolarów. Czy etyczna AI może wygrać z wielkimi kontraktami rządowymi?

Gdy etyka spotyka wielkie pieniądze: dlaczego decyzja Anthropic budzi takie emocje Informacja, że amerykański startup Anthropic – twórca modelu Claude – odmówił udziału w kontrakcie z Pentagonem szacowanym na około 200 mln dolarów, szybko obiegła branżowe media i sieci społecznościowe. Chodziło nie tylko o skalę potencjalnych przychodów, ale przede wszystkim o powód: obawy etyczne i…

-

Dlaczego Nvidia dystansuje się od OpenAI i Anthropic? Strategiczny zwrot w dojrzałym rynku generatywnej AI

Nowy sygnał z Doliny Krzemowej: co naprawdę powiedział Jensen Huang o inwestycjach w OpenAI i Anthropic Nvidia w ostatnich latach stała się największym beneficjentem globalnego boomu na generatywną sztuczną inteligencję. Jej układy GPU są podstawą infrastruktury obliczeniowej dla modeli takich jak ChatGPT czy Claude, a prezes Jensen Huang wyrósł na jednego z kluczowych architektów współczesnego…

-

Anthropic kontra Pentagon: test granic etycznej sztucznej inteligencji w wojsku USA

Dlaczego spór Anthropic z Pentagonem stał się sprawą globalną: tło, stawka i główni aktorzy W ciągu zaledwie kilku lat generatywna sztuczna inteligencja z narzędzia dla programistów i marketerów stała się jednym z kluczowych zasobów strategicznych państw. Stany Zjednoczone, które tradycyjnie opierają swoją przewagę militarną na technologiach, dziś patrzą na modele językowe i systemy analizujące dane…

-

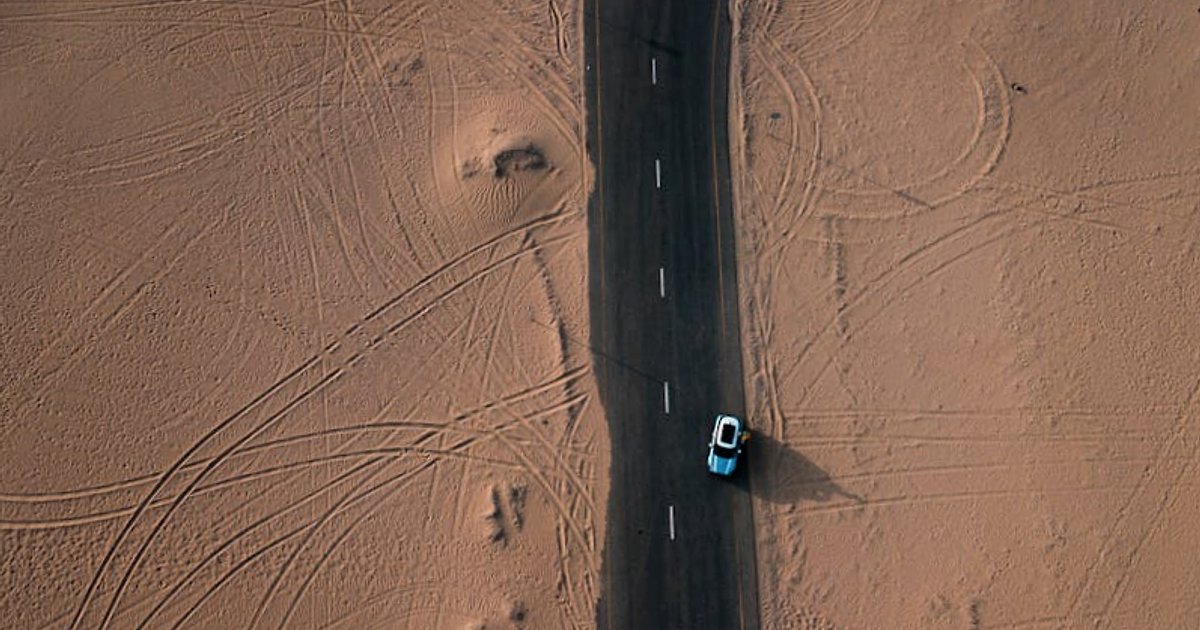

Sztuczna inteligencja w Pentagonie i drony Shahed: jak AI zmienia zasady gry na Bliskim Wschodzie

Pentagon sięga po sztuczną inteligencję: co wiemy o wykorzystaniu modelu Anthropic do wyboru celów w Iranie W ostatnich tygodniach opinię publiczną zelektryzowały doniesienia „Washington Post”, że Pentagon wykorzystuje model sztucznej inteligencji opracowany przez firmę Anthropic do wspierania procesu wyboru celów w Iranie. Chodzi o system klasy dużego modelu językowego (LLM), który nie tylko analizuje dane…

-

Trump usuwa Anthropic z Pentagonu: nowa era polityki wobec sztucznej inteligencji

Jak decyzja Trumpa wobec Anthropic zmienia obraz amerykańskiej polityki technologicznej Decyzja administracji Donalda Trumpa o usunięciu Anthropic z projektów Pentagonu i objęciu tej firmy szerokim zakazem wykorzystania jej technologii w agencjach federalnych stała się jednym z najbardziej spektakularnych zwrotów w relacjach państwo–Big Tech w ostatnich latach. Chodzi nie tylko o pojedynczy kontrakt, lecz o zasadnicze…

-

Palantir vs Anthropic: jak spór o guardrails w Pentagonie przebudowuje rynek militarnej AI

Dlaczego konflikt Palantira z Anthropic stał się punktem zwrotnym dla militarnej sztucznej inteligencji Spór między Palantir Technologies a Anthropic dotyczący wykorzystania modeli sztucznej inteligencji przez amerykański Departament Obrony stał się jednym z najważniejszych testów granic między interesem państwa, logiką rynku defense‑tech a zasadami bezpieczeństwa deklarowanymi przez prywatne laboratoria AI. W lutym i marcu 2026 r.…

-

OpenAI, Anthropic i NATO: jak Zachód militarizuje sztuczną inteligencję

Dlaczego współpraca Big Tech z wojskiem staje się kluczowym testem dla sztucznej inteligencji Sztuczna inteligencja jeszcze kilka lat temu kojarzyła się głównie z rekomendacjami filmów, chatbotami obsługującymi infolinie czy filtrami w mediach społecznościowych. Dziś to samo narzędzie staje się jednym z głównych pól sporu między polityką, biznesem a etyką technologii. W centrum tego sporu znalazły…