Dlaczego najnowsze megainwestycje w AI zmieniają zasady gry dla całej gospodarki

W latach 2024–2026 inwestycje w infrastrukturę sztucznej inteligencji osiągają skalę, która wykracza daleko poza tradycyjny sektor IT. W centrum uwagi znajdują się generatywne modele językowe i multimodalne, których rozwój wymaga potężnych zasobów obliczeniowych, gigantycznych centrów danych, specjalistycznych chipów oraz stabilnego dostępu do energii. Konkurencja między największymi firmami technologicznymi – Microsoftem, Google, Amazonem i Metą – przyspiesza, a na scenę wchodzą nowe podmioty, takie jak World Labs czy azjatyccy giganci infrastruktury z Indiami i Tata Group na czele.

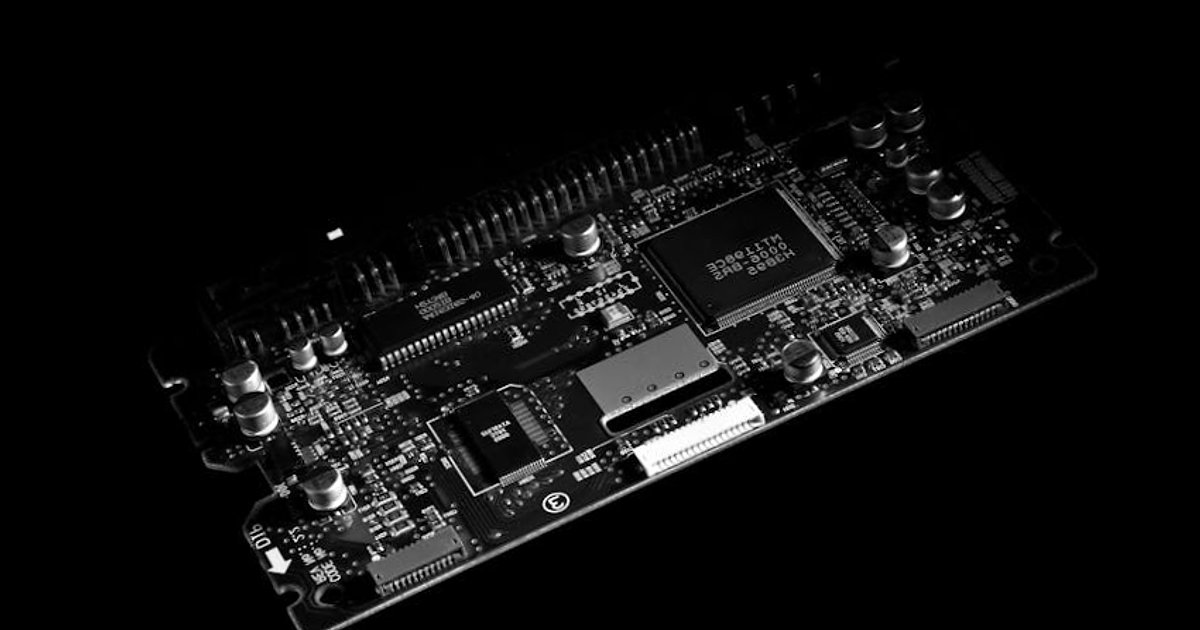

Infrastruktura AI to nie tylko abstrakcyjne „chmury” i „modele”. W praktyce obejmuje ona kilka kluczowych elementów. Po pierwsze, wyspecjalizowane procesory – przede wszystkim GPU i coraz częściej układy ASIC zaprojektowane specjalnie pod trenowanie i uruchamianie dużych modeli. Po drugie, centra danych – ogromne hale serwerowe z zaawansowanym chłodzeniem, zabezpieczeniami i łącznością światłowodową. Po trzecie, sieci transmisji danych, które łączą te centra w skali globalnej z opóźnieniami liczonymi w milisekundach. Po czwarte, energia – w dużej mierze elektryczność, ale też woda do chłodzenia. Po piąte wreszcie, talenty: inżynierowie, badacze, specjaliści od bezpieczeństwa i operacji w chmurze.

Rozwój generatywnej AI powoduje gwałtowny wzrost zapotrzebowania na wszystkie te zasoby. Z jednej strony pojawiają się rekordowe rundy finansowania, z drugiej – rosną obawy o koncentrację mocy obliczeniowej w rękach kilku globalnych graczy. Obok wielkiej czwórki Big Tech uwagę przyciąga miliardowa runda kapitału dla World Labs, bezprecedensowe finansowanie OpenAI, którego nowa runda według doniesień opartych na źródłach cytowanych przez Bloomberg może przekroczyć 100 mld dolarów i wycenę 850 mld dolarów, oraz ofensywa inwestycyjna Tata w lokalne centra danych w Indiach.

Te trzy wątki – nowe laboratoria, rekordowe finansowanie lidera rynku oraz budowa lokalnej infrastruktury w kluczowym kraju rozwijającym się – razem rysują nowy układ sił w globalnej gospodarce cyfrowej. Zyskują regiony, które potrafią połączyć kapitał, regulacje i energię. W tyle pozostają państwa ograniczające się do bycia wyłącznie konsumentami gotowych modeli. Artykuł adresowany jest do analityków rynku, konsultantów i menedżerów ds. strategii technologicznej, ale w przystępny sposób wyjaśnia konsekwencje tych ruchów dla całej gospodarki.

Nowa fala kapitału dla modeli generatywnych: World Labs i rekordowa runda OpenAI

Finansowanie firm rozwijających modele foundation – czyli duże, ogólnego przeznaczenia modele wykorzystywane później w wielu zastosowaniach – wchodzi w nową fazę. Wczesne rundy kapitałowe prowadzone przez wyspecjalizowane fundusze venture capital ustępują miejsca hybrydowym strukturom, w których obok VC pojawiają się wielkie korporacje technologiczne, fundusze państwowe i inwestorzy instytucjonalni. Dla nich modele generatywne to już nie eksperyment, lecz infrastruktura krytyczna, porównywalna z sieciami energetycznymi czy telekomunikacyjnymi.

W tym kontekście pojawia się World Labs – nowy typ podmiotu, który można opisać jako laboratorium badawczo-inżynieryjne skoncentrowane na budowie własnych zaawansowanych modeli i powiązanej infrastruktury. Miliardowa runda kapitałowa, jaką pozyskują takie organizacje, nie jest jedynie „paliwem na badania”. Większość środków trafia na bardzo konkretne wydatki infrastrukturalne: zakup klastrów GPU, rozbudowę własnych serwerowni, zabezpieczenie długoterminowych kontraktów z dostawcami chmury (tzw. hyperscalerami) i agresywną rekrutację talentów.

Skalę tych wydatków najlepiej oddają szacunkowe scenariusze. Budowa klastra obejmującego kilkadziesiąt tysięcy najnowszych procesorów AI wraz z infrastrukturą sieciową i zasilaniem może pochłonąć od kilkuset milionów do ponad miliarda dolarów. Do tego dochodzą roczne koszty energii idące w setki milionów dolarów oraz stale rosnące wynagrodzenia specjalistów. Przy takich liczbach miliardowa runda finansowania wystarcza nie na dekadę, lecz często na kilka pierwszych lat intensywnej ekspansji.

Jeszcze mocniej wymiar tej nowej fali kapitału widać na przykładzie OpenAI. Według najnowszych doniesień analityków powołujących się na osoby znające szczegóły transakcji, pierwsza faza nowej rundy finansowania ma przynieść ponad 100 mld dolarów, a całkowita wycena spółki może przekroczyć 850 mld dolarów. Z wcześniejszych informacji agencyjnych wynika, że pre-money valuation, czyli wycena sprzed napływu nowego kapitału, utrzymywana jest w okolicach 730 mld dolarów, a część komentarzy rynkowych wskazuje, że łączny wolumen finansowania w kolejnych etapach może przekroczyć 120 mld dolarów.

Tego typu runda jest bezprecedensowa w historii startupów technologicznych. Do tej pory największe prywatne finansowania liczone były w dziesiątkach miliardów, nie w setkach. Tak ogromne zaangażowanie kapitału oznacza, że rynek oczekuje od OpenAI strumienia przychodów porównywalnego z największymi firmami oprogramowania na świecie. Źródła tych przychodów są zdywersyfikowane: klasyczny model SaaS, sprzedaż dostępu do interfejsów API, licencje dla dużych korporacji, integracje z systemami operacyjnymi (takimi jak Windows) oraz partnerstwa z producentami urządzeń.

W praktyce finansowanie tej skali jest jednak przede wszystkim „przedpłatą” na infrastrukturę. Zarząd OpenAI wprost komunikuje plany wydatków liczonych w bilionach dolarów na budowę i współfinansowanie centrów danych, zakup procesorów AI i rozwój własnego łańcucha dostaw komponentów. Część tego kapitału ma formę strategicznych inwestycji od firm takich jak Microsoft, Amazon, Nvidia czy SoftBank, co podkreśla powiązania kapitałowe między dostawcami chmury, twórcami chipów a laboratoriami AI.

Rola Microsoftu jest tu szczególna. Połączenie długoterminowych kontraktów chmurowych, kapitału własnego oraz głębokiej integracji produktów OpenAI z ekosystemem Windows i Microsoft 365 tworzy efekt silnej zależności. Inni inwestorzy instytucjonalni, w tym fundusze państwowe z Bliskiego Wschodu, traktują OpenAI jako szansę na udział w przyszłych rentach infrastrukturalnych. Tak skoncentrowane finansowanie nasila efekt „zwycięzca bierze większość” – kilka globalnych laboratoriów może zdominować zarówno rynek modeli foundation, jak i kontrolę nad bazową infrastrukturą obliczeniową.

Energia, GPU i lokalne centra danych: strategiczny wymiar projektu Tata w Indiach

Na tle gigantycznych rund inwestycyjnych równie istotne jest to, gdzie fizycznie powstają nowe moce obliczeniowe. Indie coraz wyraźniej pozycjonują się jako kluczowy węzeł infrastruktury AI. Kraj dysponuje jedną z najszybciej rosnących gospodarek cyfrowych na świecie, ogromnym rynkiem usług IT i BPO oraz bogatymi zasobami talentów inżynierskich. Tata Group – konglomerat o kompetencjach sięgających od przemysłu ciężkiego po zaawansowane technologie – wykorzystuje tę pozycję, rozwijając lokalne centra danych i wchodząc w partnerstwa z globalnymi firmami AI i dostawcami chmur.

Projekt budowy sieci lokalnych centrów danych w Indiach ma trzy kluczowe wymiary: energetyczny, sprzętowo-logistyczny oraz związany z talentami i ekosystemem innowacji.

Energia: ryzyka i szanse w gorącym klimacie

Centra danych AI pochłaniają ogromne ilości energii elektrycznej. Trening pojedynczego dużego modelu językowego może zużyć energię równą wieloletniemu zużyciu setek gospodarstw domowych. Do tego dochodzi zapotrzebowanie na wodę do chłodzenia serwerów oraz konieczność utrzymania wysokiej niezawodności zasilania. W Indiach oznacza to napięcie między ambicjami rozwoju infrastruktury cyfrowej a wyzwaniami lokalnego systemu energetycznego.

Z jednej strony kraj zmaga się z upałami, okresowymi niedoborami energii i obciążeniem sieci w szybko urbanizujących się regionach. Z drugiej – intensywnie rozwija odnawialne źródła energii (OZE), w tym farmy słoneczne i wiatrowe, oraz oferuje inwestorom możliwość zawierania długoterminowych umów PPA (power purchase agreement). Dla operatorów centrów danych, w tym Tata i jej partnerów, połączenie lokalnych źródeł OZE z kontraktami PPA staje się sposobem na obniżenie kosztów i zmniejszenie śladu węglowego.

Sprzęt i łańcuch dostaw: klastry GPU w indyjskim wydaniu

Drugi wymiar to sprzęt i logistyka. Budowa nowoczesnego centrum danych do celów AI wymaga nie tylko zakupu samych procesorów, ale także zaawansowanej inżynierii budowlanej, niezawodnej infrastruktury sieciowej i lokalnego serwisu. Tata, dzięki doświadczeniu w sektorach przemysłowym, telekomunikacyjnym i IT, może pełnić rolę integratora całego łańcucha wartości.

Klastry GPU można w uproszczeniu porównać do olbrzymich farm komputerowych, gdzie tysiące wyspecjalizowanych chipów współpracuje jednocześnie nad przetwarzaniem danych. GPU (graphics processing units) i ich następcy – specjalne procesory AI – są zoptymalizowane do wykonywania wielu małych operacji równolegle, co jest kluczowe przy trenowaniu dużych modeli. W praktyce oznacza to sieć połączonych serwerów, wyposażonych w szybkie łącza światłowodowe i zasilanych z redundantnych źródeł energii.

Partnerstwa pomiędzy Tata a globalnymi dostawcami chmur lub twórcami modeli pozwalają przenieść część tej infrastruktury bliżej użytkowników w regionie Azji Południowej. Z perspektywy globalnego rynku oznacza to dywersyfikację geograficzną mocy obliczeniowych i mniejsze ryzyko związane z koncentracją wszystkiego w kilku lokalizacjach w USA czy Europie.

Lokalny ekosystem i talenty: Indie jako laboratorium dla globalnego IT

Trzecim filarem jest powiązanie infrastruktury z lokalnym ekosystemem talentów i innowacji. Indie od lat są jednym z głównych hubów usług IT i BPO dla korporacji z całego świata. Rozbudowa centrów danych zwiększa atrakcyjność kraju jako miejsca, gdzie można nie tylko świadczyć usługi, ale również rozwijać zaawansowane produkty AI.

Uniwersytety techniczne, rosnąca liczba startupów AI oraz zaplecze dużych firm usługowych tworzą środowisko, w którym łatwiej budować zespoły wyspecjalizowane w wykorzystaniu AI w finansach, sektorze zdrowotnym czy przemyśle. Szczególnie widoczne jest to w obszarze oprogramowania. Integracja agentów AI wspierających programistów – takich jak asystenci do kodu – zmienia model pracy globalnych zespołów developerskich. Przykładem jest opisany szerzej w materiale agent do kodu w Indiach wykorzystujący rozwiązania Anthropic, który pokazuje, jak połączenie lokalnej infrastruktury i zaawansowanych modeli wpływa na globalny biznes IT. Z kolei z perspektywy samych programistów praktyczne korzyści opisuje tekst How Artificial Intelligence Can Help Software Developers, ilustrujący, jak infrastruktura AI przekłada się na codzienną pracę zespołów inżynierskich.

Mapa geopolityczna infrastruktury AI: kto wygrywa, kto ryzykuje pozostanie w tyle

Globalny wyścig po infrastrukturę AI ma wyraźny wymiar geopolityczny. Kapitał, regulacje, energia i talenty koncentrują się w kilku głównych regionach, co tworzy nową mapę wpływów technologicznych.

Stany Zjednoczone pozostają dominującym graczem kapitałowym. Największe rundy finansowania – zarówno OpenAI, jak i innych liderów generatywnej AI – ulokowane są w Dolinie Krzemowej i powiązanych ośrodkach. Tu też znajduje się największa koncentracja talentów badawczo-inżynieryjnych oraz kapitału ryzyka gotowego finansować projekty obarczone ogromnym ryzykiem technologicznym i regulacyjnym. Jednocześnie rośnie obawa przed nadmierną koncentracją mocy obliczeniowej w rękach kilku firm i kilku geograficznych hubów, głównie na zachodnim wybrzeżu USA.

Europa zajmuje odmienną pozycję. Dysponuje silnym aparatem regulacyjnym, czego symbolem jest unijne rozporządzenie AI Act, oraz rosnącym ekosystemem startupów AI. Brakuje jednak spektakularnych, skoncentrowanych rund finansowania porównywalnych ze skalą OpenAI czy największych firm amerykańskich. Powstaje dylemat: czy ostrożna polityka regulacyjna, nastawiona na ochronę praw obywateli i bezpieczeństwo, nie doprowadzi do drenażu innowacji i przesuwania inwestycji infrastrukturalnych do bardziej liberalnych jurysdykcji? Jednocześnie, jeśli AI Act stanie się globalnym punktem odniesienia, europejskie firmy mogą zyskać przewagę w obszarze zaufania i zgodności z regulacjami.

W Azji krajobraz jest zróżnicowany. Chiny rozwijają własny, silnie wspierany przez państwo ekosystem AI z dużymi nakładami na infrastrukturę oraz lokalne odpowiedniki zaawansowanych chipów. Ograniczenia eksportowe GPU ze strony USA przyspieszyły prace nad krajowymi procesorami AI i równoległym ekosystemem sprzętowo-programowym, który ma być odporny na sankcje. Indie, jak pokazuje przykład Tata, rosną jako hub usług IT, centrów danych i lokalnych zastosowań AI dla globalnych klientów, w tym w segmencie korporacyjnym.

Ograniczenia w handlu technologiami AI zwiększają prawdopodobieństwo powstania w najbliższych latach równoległych ekosystemów: jednego opartego o USA i sprzymierzone gospodarki, drugiego skupionego wokół Chin, a potencjalnie trzeciego – hybrydowego, gdzie silną rolę odgrywają Indie i państwa Zatoki Perskiej. Dla średnich i mniejszych krajów oznacza to konieczność wyboru partnerów technologicznych i regulacyjnych.

Można zaproponować prostą typologię państw w tym nowym porządku. Pierwsza grupa to „huby infrastrukturalne” – kraje budujące duże moce obliczeniowe, przyciągające centra danych dzięki taniej, stabilnej i często zielonej energii. Należą do nich niektóre państwa nordyckie, Kanada czy wybrane kraje Zatoki Perskiej. Druga grupa to „huby aplikacyjne” – państwa i regiony, które nie posiadają własnej, dużej infrastruktury, ale specjalizują się w budowie aplikacji, usług i produktów opartych na cudzych modelach i chmurach. Trzecia kategoria to „spóźnieni regulatorzy”, którzy nie zbudowali ani lokalnej infrastruktury, ani mocnego ekosystemu aplikacji, a jednocześnie nie posiadają jasnej strategii regulacyjnej. Te gospodarki ryzykują, że pozostaną wyłącznie konsumentami zagranicznych rozwiązań, bez realnego wpływu na standardy i podział korzyści ekonomicznych.

Kapitał spotyka regulacje i etykę: rola państw, armii i „czerwonych linii”

Megainwestycje w AI nie powstają w próżni. W tle toczy się intensywna debata o regulacjach, bezpieczeństwie i zastosowaniach wojskowych nowych technologii. Państwa starają się z jednej strony wspierać rozwój infrastruktury – poprzez ulgi podatkowe, granty, przetargi publiczne i zamówienia na rozwiązania AI – a z drugiej wprowadzają ograniczenia dotyczące wykorzystania modeli w nadzorze obywateli, kampaniach politycznych czy systemach broni autonomicznej.

W USA strategia władz federalnych i poszczególnych stanów łączy wsparcie inwestycji infrastrukturalnych z coraz większą uwagą wobec ryzyk. W Europie kluczową rolę odgrywa AI Act, ale równolegle toczą się dyskusje o dodatkowych ograniczeniach sektorowych, np. w finansach czy ochronie zdrowia. Firmy budujące infrastrukturę AI muszą więc godzić oczekiwania inwestorów z rosnącą presją regulacyjną i reputacyjną.

Szczególnie delikatny jest obszar współpracy laboratoriów AI z instytucjami wojskowymi i służbami bezpieczeństwa. Kontrakty obronne mogą opiewać na wielomiliardowe kwoty i w praktyce finansować budowę kolejnych centrów danych oraz klastrów GPU. Jednocześnie wywołują ostre spory wewnątrz firm, które deklarują wysokie standardy etyczne. Przykładem jest opisana szerzej w tekście dyskusja wokół „czerwonych linii” etycznych w relacjach Anthropic z Pentagonem, pokazująca, jak decyzje dotyczące dopuszczalnych zastosowań modeli mogą mieć bezpośrednie konsekwencje biznesowe.

Napięcie między etyką a zyskownością ma również wymiar geograficzny. Jeżeli część firm odmawia udziału w projektach wojskowych w określonych jurysdykcjach, kontrakty mogą trafiać do konkurencji mniej restrykcyjnej etycznie lub do podmiotów działających w krajach, gdzie normy są łagodniejsze. To z kolei wpływa na to, gdzie budowana jest infrastruktura – centra danych mogą powstawać bliżej partnerów wojskowych, a niekoniecznie w regionach o najwyższych standardach ochrony praw człowieka. Dla strategów technologicznych w dużych organizacjach oznacza to konieczność łączenia analizy finansowej z oceną ryzyka reputacyjnego i politycznego.

Scenariusze na najbliższe 5 lat: co oznaczają dzisiejsze decyzje inwestycyjne dla strategów technologicznych

Dzisiejsze megainwestycje – od rundy OpenAI po projekty Tata – wyznaczają ramy rozwoju infrastruktury AI do około 2030 roku. Można wskazać trzy realistyczne scenariusze, które powinny znaleźć się na radarze analityków rynku, konsultantów i menedżerów ds. strategii technologicznej.

Pierwszy scenariusz to „superkoncentracja”. Kilka globalnych laboratoriów – na przykład OpenAI, World Labs i dwaj–trzej najwięksi konkurenci – dominuje zarówno w obszarze modeli foundation, jak i samej infrastruktury. Reszta rynku buduje przede wszystkim aplikacje i usługi na ich platformach. W tym świecie kluczowe decyzje strategiczne w firmach dotyczą wyboru jednego z 2–3 dominujących ekosystemów chmurowo-modelowych, zarządzania ryzykiem vendor lock-in oraz negocjowania korzystnych warunków dostępu do mocy obliczeniowych. Dla sektora finansowego czy opieki zdrowotnej oznacza to potencjalnie większą standaryzację, ale też uzależnienie od polityki cenowej i regulacyjnej kilku korporacji.

Drugi scenariusz to „zbalansowane bloki”. USA, Unia Europejska i Azja (z podziałem na Chiny i Indie plus państwa regionu) budują równoległe ekosystemy z własnymi standardami regulacyjnymi, hubami infrastrukturalnymi i lokalnymi czempionami. Tata oraz podobne grupy w innych regionach odgrywają istotną rolę jako partnerzy dla globalnych laboratoriów, ale też jako budowniczowie regionalnych mocy obliczeniowych. W takim układzie strategiczne działy firm globalnych muszą nauczyć się prowadzić zróżnicowaną politykę: inne rozwiązania infrastrukturalne dla Europy (z silnym reżimem regulacyjnym), inne dla USA, a jeszcze inne dla Azji, z uwzględnieniem ograniczeń eksportowych i suwerenności danych.

Trzeci scenariusz to „rozproszona infrastruktura”. Część państw, pod wpływem rosnących cen energii, presji klimatycznej i wymogów dotyczących lokalizacji danych, zaczyna premiować mniejsze, lokalne centra danych i wyspecjalizowane modele sektorowe. Regulacje wymuszają, aby dane wrażliwe (np. medyczne czy finansowe) były przetwarzane w kraju lub regionie, a nie w odległych hyperscalerach. Pojawiają się wyspecjalizowane klastry AI dla konkretnych sektorów: finansów, przemysłu czy administracji publicznej. Dla firm oznacza to większe zróżnicowanie partnerów infrastrukturalnych, konieczność łączenia dużych, globalnych modeli z lokalnymi, mniejszymi modelami oraz bardziej złożone zarządzanie zgodnością regulacyjną.

Każdy z tych scenariuszy ma konsekwencje sektorowe. W finansach wybór regionu i dostawcy infrastruktury może zadecydować o czasie wprowadzenia nowych produktów analitycznych czy usług personalizowanych. W opiece zdrowotnej lokalizacja centrów danych i poziom certyfikacji bezpieczeństwa zadecyduje o tym, czy regulator dopuści wykorzystanie generatywnej AI w diagnostyce. W przemyśle zdolność do trenowania modeli blisko źródeł danych (np. fabryk) może przesądzić o konkurencyjności rozwiązań Przemysłu 4.0.

Jak przełożyć globalne megatrendy na konkretne decyzje w firmie

Dla decydentów biznesowych kluczowe jest przekształcenie globalnych megatrendów w konkretne pytania strategiczne. Megarundy finansowania, inwestycje w centra danych czy debaty o etyce AI nie są abstrakcyjnymi ciekawostkami. Bezpośrednio wpływają na koszty, dostępność i możliwości wdrażania rozwiązań AI w organizacji.

Warto, aby analitycy rynku, konsultanci i menedżerowie ds. strategii technologicznej regularnie wracali do kilku fundamentalnych pytań:

- Jakie scenariusze regulacyjne są najbardziej prawdopodobne w krajach i regionach, w których działamy, i jak wpłyną one na możliwość korzystania z globalnych modeli AI?

- Na ile nasza firma jest zależna od pojedynczego dostawcy infrastruktury AI (chmury, modeli foundation, sprzętu) i jakie są scenariusze awaryjne?

- Czy lokalizacja naszych danych i mocy obliczeniowych jest zgodna zarówno z wymogami compliance, jak i rosnącymi oczekiwaniami klientów w zakresie prywatności, bezpieczeństwa i śladu węglowego?

- Jakie kompetencje w obszarze AI – od zespołów wewnętrznych po kluczowych partnerów – musimy zbudować w ciągu najbliższych 2–3 lat, aby nie być wyłącznie biernym odbiorcą technologii?

- Jak zmieni się nasz model kosztowy, jeśli założymy dalszy wzrost cen energii oraz większą rolę regulacji środowiskowych w lokalizacji centrów danych?

- W których obszarach naszej działalności krytyczne staje się łączenie globalnych modeli z lokalną infrastrukturą (np. ze względu na dane wrażliwe, suwerenność danych czy wymagania branżowe)?

- Jakie ryzyka etyczne i reputacyjne wiążą się z wyborami partnerów AI, zwłaszcza w kontekście ich zaangażowania w projekty wojskowe lub kontrowersyjne zastosowania nadzorcze?

Odpowiedzi na te pytania wymagają stałego monitorowania rynku: od doniesień o kolejnych rundach finansowania OpenAI i nowych graczy takich jak World Labs, przez projekty infrastrukturalne w Indiach, państwach nordyckich czy krajach Zatoki, po zmiany regulacyjne w USA, UE i Azji. Warto traktować je nie jako odległe sygnały z branży technologicznej, lecz jako kluczowe zmienne wejściowe do planowania strategicznego.

Dla wielu organizacji kolejnym krokiem będzie pogłębienie wiedzy o praktycznych zastosowaniach AI – zarówno w obszarze programowania, jak i szerzej w globalnym biznesie IT oraz relacjach między firmami technologicznymi a państwami. Pomocne mogą być tu powiązane materiały, takie jak wspomniane wcześniej analizy dotyczące agenta do kodu w Indiach czy roli sztucznej inteligencji w pracy programistów, a także tekst o etycznych „czerwonych liniach” w relacjach firm AI z Pentagonem. Razem tworzą one obraz świata, w którym infrastruktura AI staje się nową warstwą gospodarki – równie ważną jak sieci energetyczne czy system finansowy – a decyzje podejmowane dziś będą determinować przewagi konkurencyjne firm i państw w nadchodzącej dekadzie.